AI“换脸”获判,“偷声”困局怎么破?配音演员集体维权,律师剖析困境:举证难、成本高、获益低

2026-03-24 23:04:15未知 作者:徽声在线

在人工智能(AI)技术迅猛发展的浪潮下,演员的脸部特征与声音资源正成为被非法利用的“重灾区”。

时间来到2025年,一起涉及某短剧疑似利用AI技术换脸迪丽热巴的事件,在影视行业内掀起了轩然大波。时隔一年,北京互联网法院对此类肖像权纠纷案件进行了通报,明确了制作方与播出方的侵权责任,为肖像权的法律保护划定了清晰的司法界限。与此同时,边江、季冠霖等知名配音演员也纷纷站出来,公开维权,直指AI技术“窃取”了他们的声音。

随着AI技术的不断进步,艺人的脸部形象与声音数据接连成为被非法窃取的对象。徽声在线记者了解到,“脸部特征尚可通过直观观察识别,但声音的相似度却难以精准判断,这导致了举证困难、维权成本高昂且收益微薄的现状。”北京市隆安律师事务所上海分所的贾玉倩律师在接受《每日经济新闻》采访时指出,从“显而易见”的换脸技术到“难以察觉”的偷声行为,AI技术正以不同的方式挑战着演员人格权的保护底线。

“神似而非完全一致”同样构成侵权

回溯至去年4月,某短剧中女演员的脸部被疑似通过AI技术换成了迪丽热巴的形象,引发了广泛争议。今年3月20日,北京互联网法院公布了此案的审理结果,认定短剧制作方利用AI换脸技术将原告的肖像拼接至短剧角色面部,导致公众误认为原告参与了该短剧的演出,此行为构成侵权;同时,播出方作为播放平台,未尽到合理的审查义务,也侵犯了原告的肖像权。最终,两被告被判公开赔礼道歉并赔偿经济损失。

据了解,该涉案短剧共有44集,总时长约90分钟,其中有两个片段使用了AI换脸技术。法院在审理过程中认为,尽管AI合成的肖像与本人存在一定差异,但只要能被一般公众或特定行业人群识别出来,即可认定为使用了特定自然人的肖像。

北京星权律师事务所的邓以勒律师在接受《每日经济新闻》采访时表示,此案为AI创作领域划定了“不得侵害人格权”的司法红线,其判决意义在于明确了AI换脸技术即使只是“神似”而非“完全一致”也构成侵权,并强调了“技术中立并不等同于责任豁免”,从证据规则上堵死了利用AI技术逃避侵权责任的可能。

在AI“换脸”维权迎来标志性判决的同时,影视行业的另一关键环节——配音演员正深陷AI“偷声”的困境。近日,曾为《甜蜜蜜》中的黎小军、《无间道》中的刘建明配音的叶清发现,自己的声音被高度还原并应用在了一部AI生成的短剧中。同样,知名配音演员季冠霖的声音也被仿冒,用于“魔改”印度版《甄嬛传》,随后他们展开了集体维权行动。

徽声在线记者进一步了解到,AI生成的声音不仅被用于制作魔改短剧、虚假广告,甚至有可能被用于诈骗等违法场景,给配音演员带来了极大的法律风险和声誉损害。

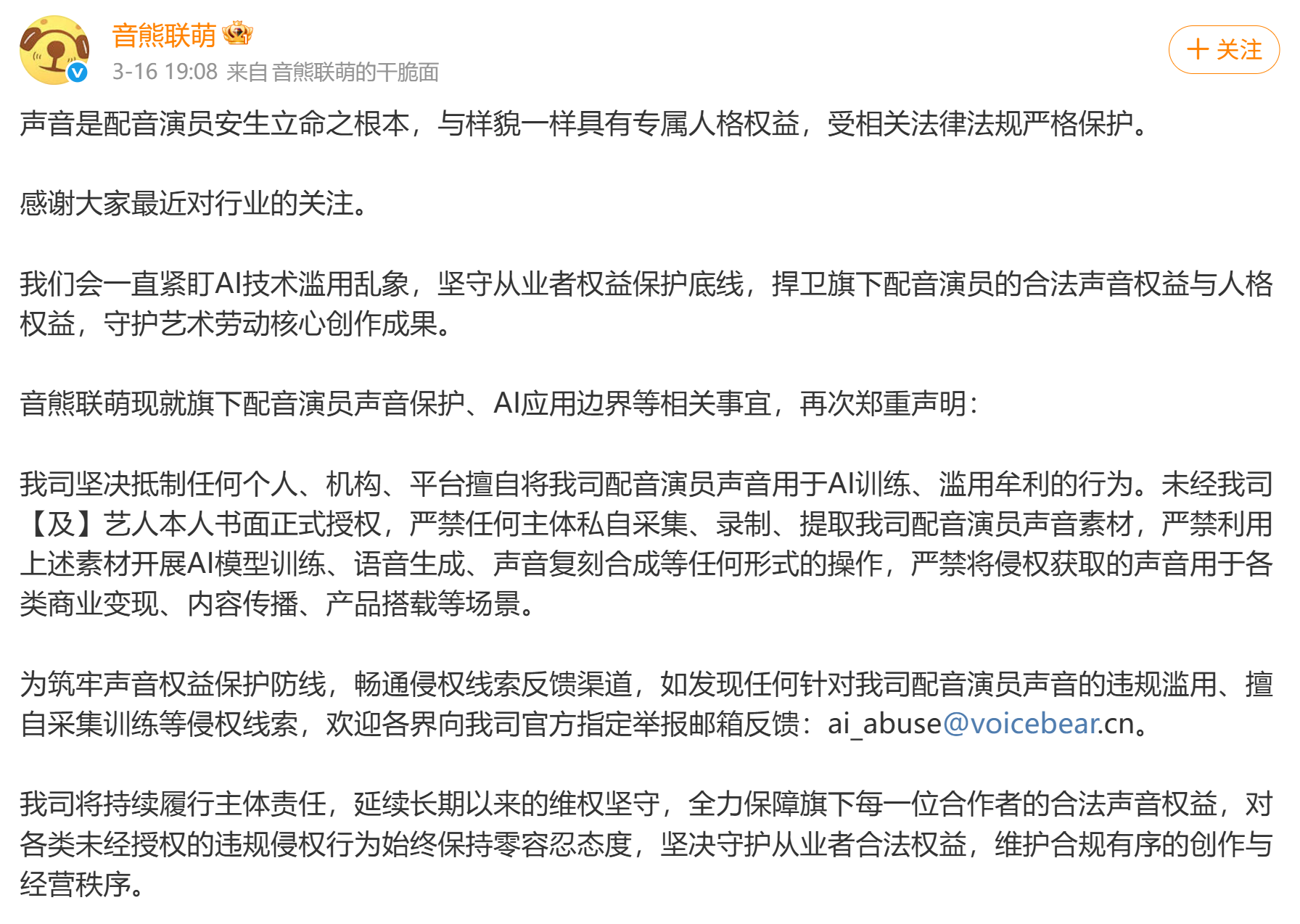

不仅配音演员个体深受其害,国内头部配音公司音熊联萌也公开表达了反对AI“偷声”的立场。该公司在声明中强调,“声音是配音演员安身立命之本,与样貌一样具有专属的人格权益,受到相关法律法规的严格保护”,并明确反对任何个人、机构或平台未经书面授权私自采集、录制、提取旗下配音演员的声音素材,并将其用于AI训练、语音生成、声音复刻合成等用途。

(图片来源:微博截图)

AI“偷声”维权之路为何艰难重重

从影视剧市场和行业的整体角度来看,贾玉倩律师认为AI换脸、偷声等问题不仅会引发观众的质疑和反感,降低行业的诚信度,还可能造成行业间的互相模仿,加剧技术的滥用。“其带来的法律风险不言而喻,低成本的诱惑导致技术滥用,进而引发行业内的恶性竞争,挤压真正优质作品的生存空间,形成‘劣币驱逐良币’的市场现象。”

与AI“换脸”相比,AI“偷声”的维权之路更为艰难,这并非因为完全“无法可依”,而是因为在实际操作中,维权的门槛明显更高。根据《民法典》的规定,对自然人声音的保护参照适用肖像权保护的有关规定。

2024年,北京互联网法院审理的全国首例AI生成声音人格权侵权案已经明确,在具备可识别性的前提下,自然人声音权益的保护范围可以延伸至AI生成的声音。然而,“有法律依据”并不等同于“容易维权”。贾玉倩律师向《每日经济新闻》记者指出,“脸部特征可以一眼识破,但声音的相似度却难以精准判断。”

贾玉倩律师进一步分析指出,虽然声音参照肖像权也受到法律保护,但其维权之路面临三大难题:首先是举证困难,面部识别的容易度远高于声音识别,普通配音演员很难证明AI训练模型中的声音数据来源于自己;其次是维权成本高昂且收益微薄,明星团队有专业法务支持,但普通配音演员难以承受;最后,民事诉讼的“不告不理”原则意味着配音演员必须主动起诉,这又回到了前两个难题上。

邓以勒律师也向《每日经济新闻》记者补充道,声音具有“转瞬即逝”的特点,难以在第一时间识别侵权行为,且检索困难,目前主要依靠人工听查,效率极低。此外,声音容易被剪辑、变速、拼接处理,原始状态难以固定,进一步增加了维权的难度。虽然面部肖像权已经有了法律的“盾牌”,但声音人格权却面临着“无明确法规、无统一鉴定标准、无高效维权路径”的尴尬局面。

全链条监管与技术水印或成破解之道

无论是AI换脸还是“偷声”,背后都反映出部分从业者在技术浪潮下的投机心态。一位影视行业人士曾告诉《每日经济新闻》记者,在短剧市场竞争日益激烈的背景下,一些制作公司信奉“唯流量论”,不惜通过“偷奸耍滑”的方式将明星的面孔或声音“植入”作品以吸引眼球,“这会扰乱行业和市场秩序,必须坚决抵制这类行为。”

多位行业和法律界人士均向《每日经济新闻》记者指出,面对AI技术带来的挑战,演员们的“脸声”保卫战需要多方共同努力。

邓以勒律师呼吁,应完善AI深度合成的全链条监管制度。她指出,声音侵权之所以难以根治,根源在于训练数据不透明、模型使用无备案。她建议,未来可以建立数据采集的知情同意规则,并落实商用AI工具的备案与标识义务,通过“事前管控”来分担“事后追责”的压力。同时,建立顺畅的投诉反馈机制,完善快速下架与溯源机制也至关重要。

在行业与个人层面,事前设防与事后维权的结合显得尤为关键。贾玉倩律师建议,演员可以在与合作方的合同中明确约定,未经授权不得使用其声音进行AI训练、合成或克隆,并通过在商用配音中嵌入水印等技术手段,实现溯源追责。

与此同时,贾玉倩律师还表示,除了诉讼之外,其他维权手段中,最快速且低成本的就是平台配合投诉快速下架侵权内容。此外,行业集体维权也可以起到壮大声势、降低个体成本的作用,再配合行政投诉、公开声明等,向公众声明被侵权事实,都可以辅助维权。